PatternRecognition-2-感知机

模式识别 U2 感知机

课堂内容

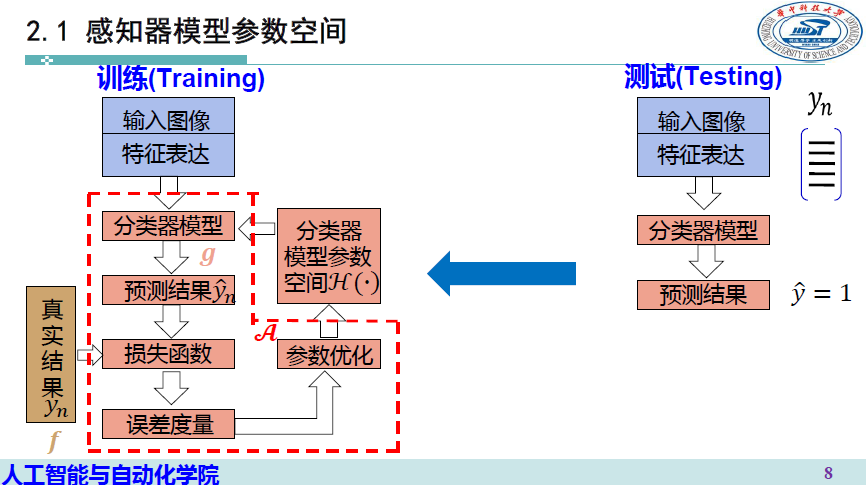

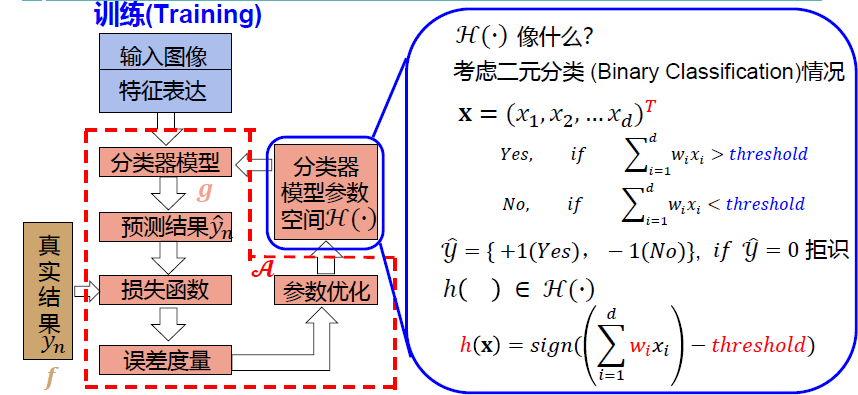

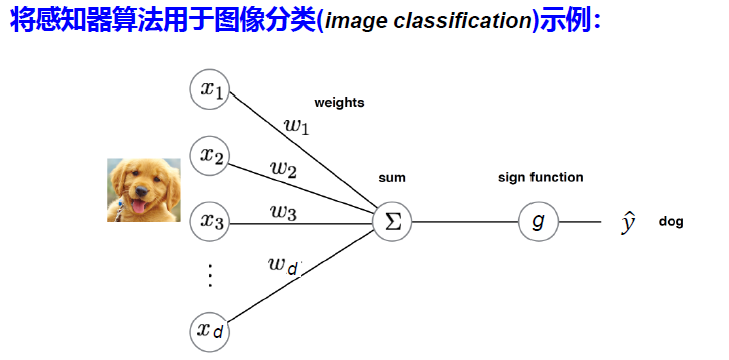

感知器模型参数空间

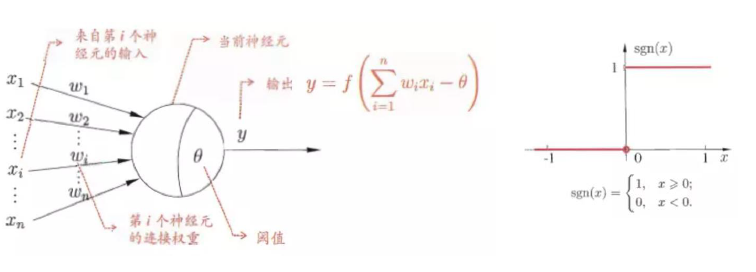

感知器 Perceptron

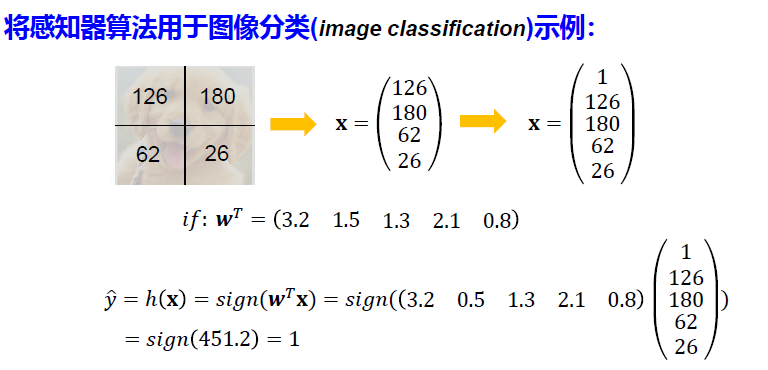

用向量形式(Vector Form)来表示感知器模型

\[ \begin{align*} h(x) &= sign((\Sigma^d_{i=1}w_ix_i)-threshold)\\ &= sign((\Sigma^d_{i=1}w_ix_i)+(-threshold)·(+1))\\ &= sign(\Sigma^d_{i=0}w_ix_i)\\ &= sign(\overrightarrow{w^T}\cdot \overrightarrow{x}) \end{align*} \]

由上式我们可知,我们将阈值threshold扩展进了原来的w权重向量中,使其作为常数偏置存在;在进行这一操作时也在X中扩展出了一维全为1的增广X

我们称新的w,X为增广化后的\(\mathbf{w}^T\)、\(\mathbf X\) $$ \[\begin{align*} \mathbf W &=[w_1, w_2, w_3,..., w_d,w_{d+1}]_{1×(d+1)}\\ \overrightarrow{x_i} &=[x_1, x_2, x_3,..., x_d, 1]_{1×(d+1)}\\ \mathbf X &=\begin{bmatrix} \overrightarrow{x_1}\\ \overrightarrow{x_2}\\ \overrightarrow{x_3}\\ ...\\ \overrightarrow{x_n}\\ \end{bmatrix}_{n×(d+1)}\\ 则\mathbf X \cdot \mathbf W^T &=\begin{bmatrix} \overrightarrow{x_1}\cdot \mathbf W^T\\ \overrightarrow{x_2}\cdot \mathbf W^T\\ \overrightarrow{x_3}\cdot \mathbf W^T\\ ...\\ \overrightarrow{x_n}\cdot \mathbf W^T\\ \end{bmatrix}_{n×1}\\ &=\begin{bmatrix} x_1^{(1)}w_1+x_2^{(1)}w_2+...+x_d^{(1)}w_d+1^{(1)}\cdot(w_{d+1})\\ x_1^{(2)}w_1+x_2^{(2)}w_2+...+x_d^{(2)}w_d+1^{(2)}\cdot(w_{d+1})\\ x_1^{(3)}w_1+x_2^{(3)}w_2+...+x_d^{(3)}w_d+1^{(3)}\cdot(w_{d+1})\\ ...\\ x_1^{(n)}w_1+x_2^{(n)}w_2+...+x_d^{(n)}w_d+1^{(n)}\cdot(w_{d+1})\\ \end{bmatrix}_{n \times 1} \end{align*}\] \ W 是 1×(d+1)维, X是 n×(d+1)维 $$

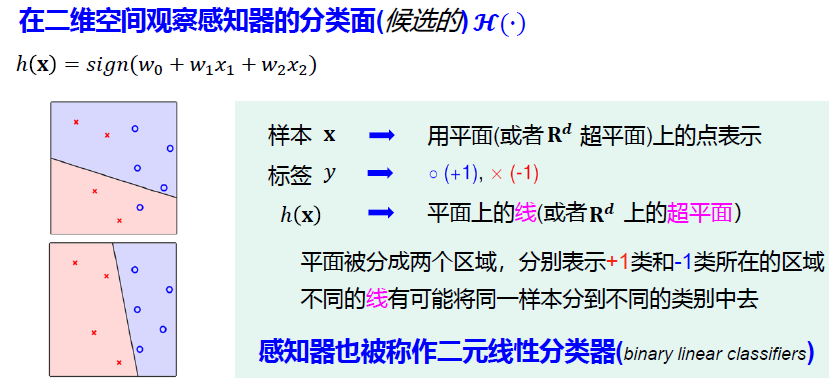

在高维空间中感知器的分类面 \[

\begin{align*}

h(x)&=sign(w_0+w_1x_1+w_2x_2+...+w_dx_d)\\

&=sign(\sum^{d}_{i=0}w_ix_i)\\

&=sign(W\cdot \bold{x})

\end{align*}

\]

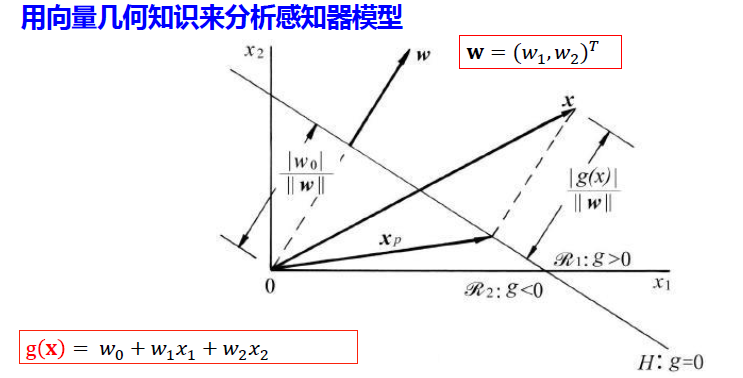

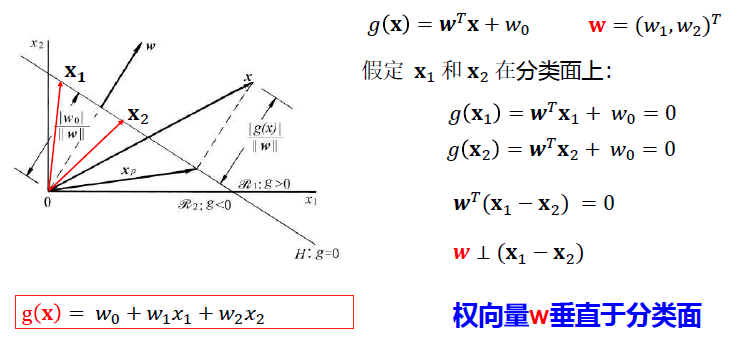

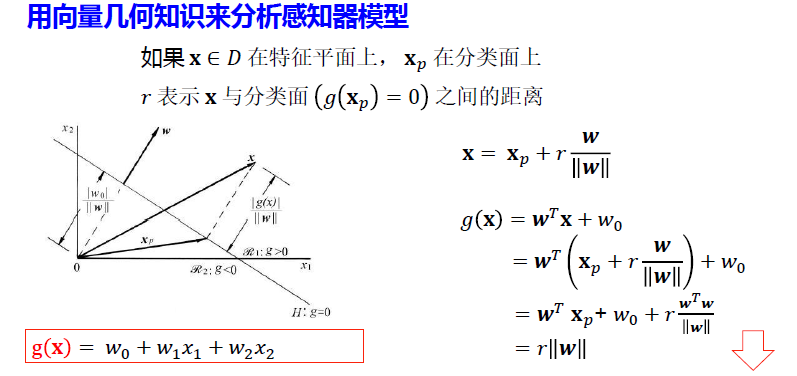

几何知识:二维中 点到直线的距离 \[ l:ax_1+bx_2+c=0\\ 则距离 \\ d=\frac{|ax_{p1}+bx_{p2}+c|}{\sqrt{a^2+b^2}} \] 扩展到如今向量几何当中 \[ d = r\frac{\mathbf{w}}{||\mathbf{w}||}\\ 其中\frac{\mathbf{w}}{||\mathbf{w}||}表示单位法向量,r则可以用标量指示距离\\ P.||\mathbf{w}||指向量的模,也可理解为向量\mathbf{w}的L_2范数 \]

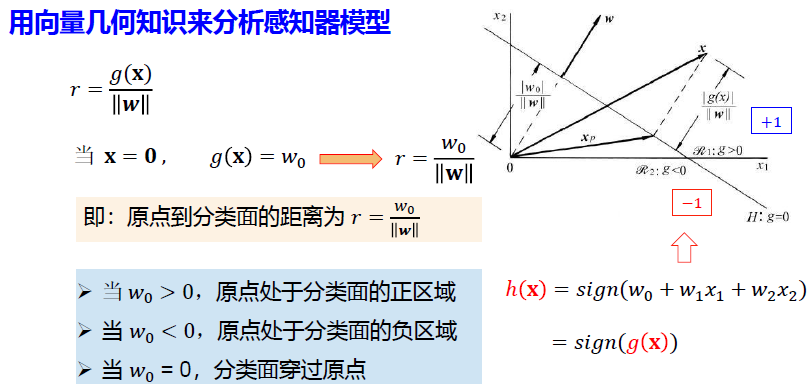

有上述推导我们可得: \[ r=\frac{g(\mathbf{x})}{||\mathbf{w}||} \] 其中

\(\mathbf{w}是训练得到的感知器模型,其本质是可学习迭代的参数集合;\\g(\mathbf{x})则是将该数据点代入模型中取得的结果\)

\(W^T\cdot X=||W||*||X||cos\theta\)

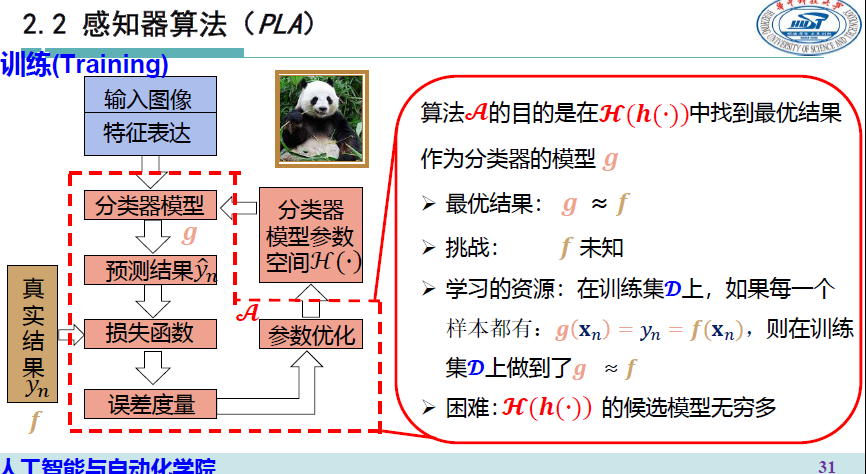

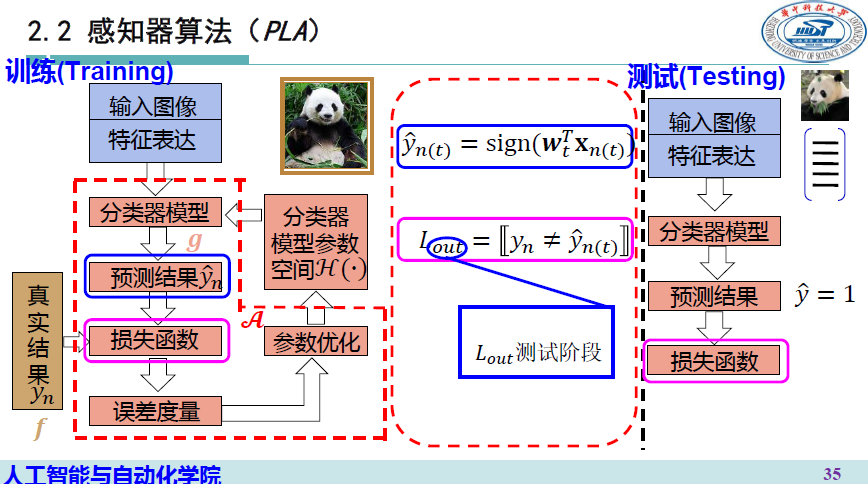

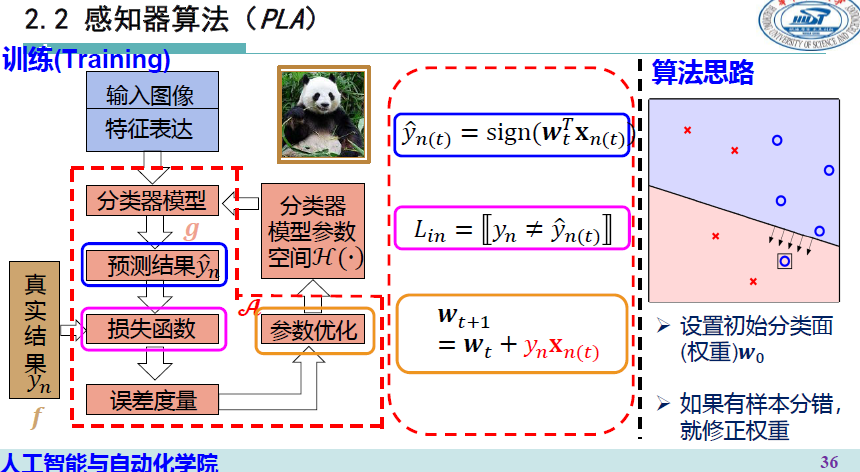

感知器算法 PLA

PLA(Perceptron Learning Algorithm)

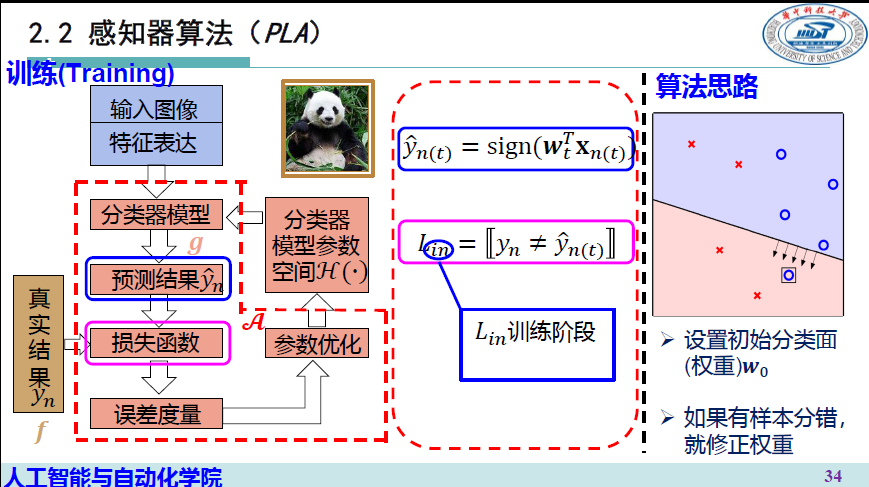

算法思路

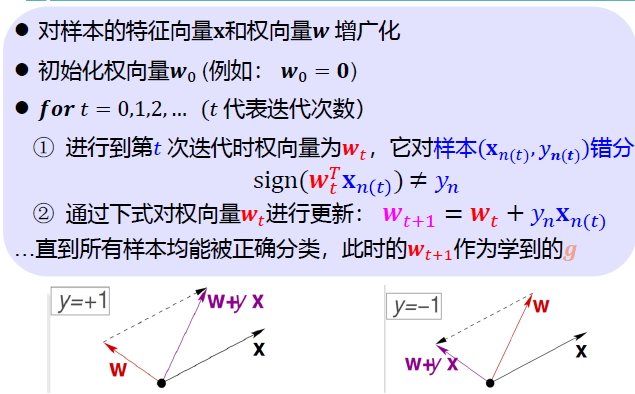

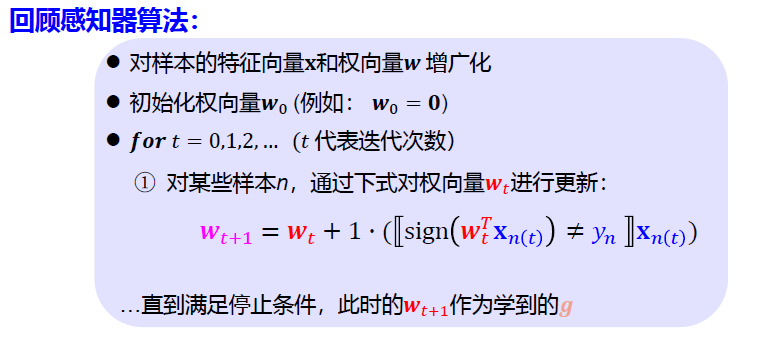

算法流程

算法迭代示例

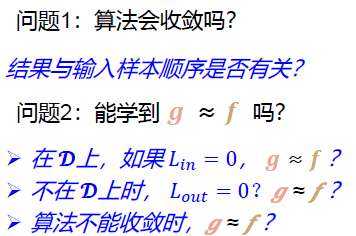

算法问题

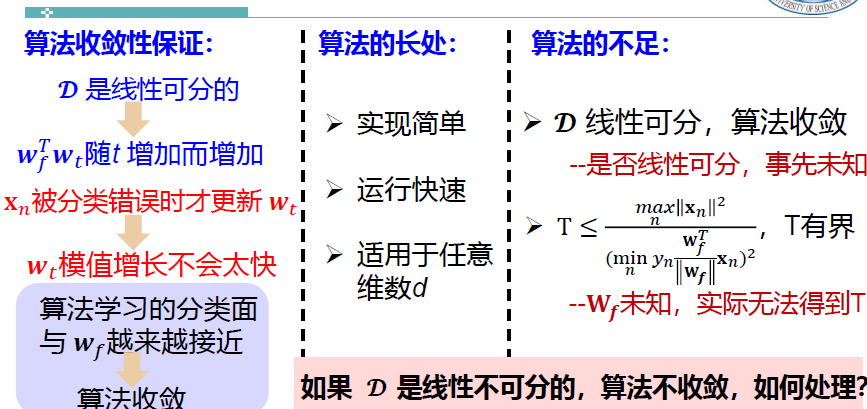

感知器算法的收敛性

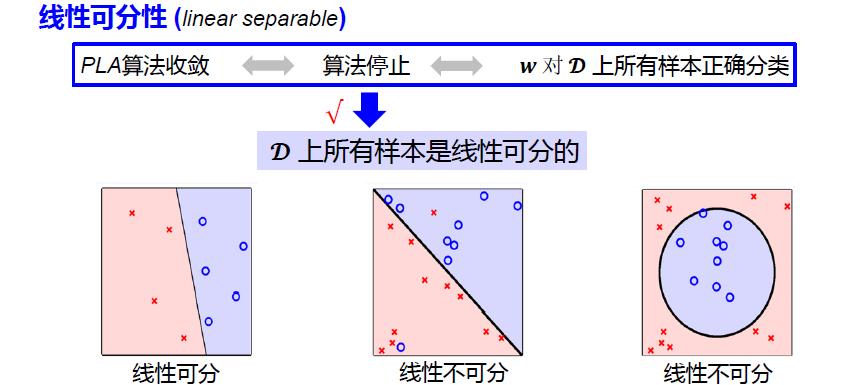

PLA收敛条件:数据集中所有样本线性可分

所有样本线性可分是否意味着PLA一定收敛?

线性不可分情况

线性不可分分析

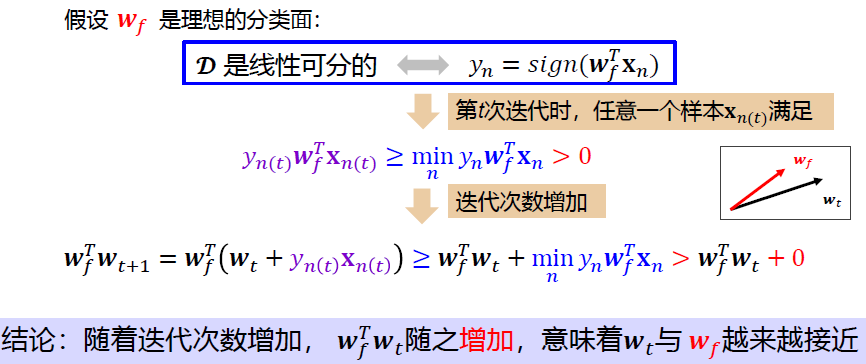

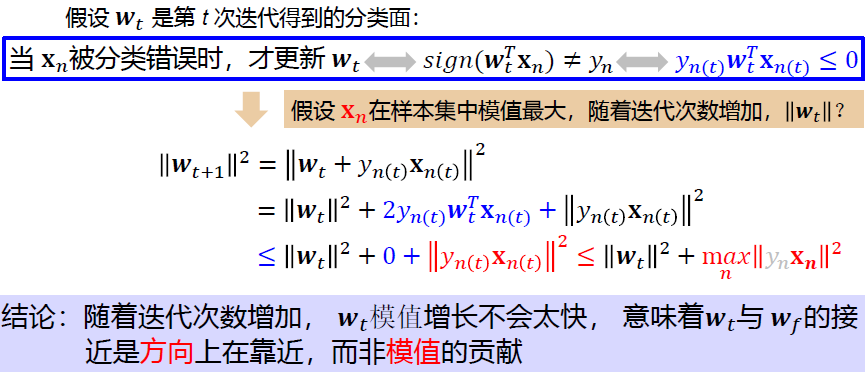

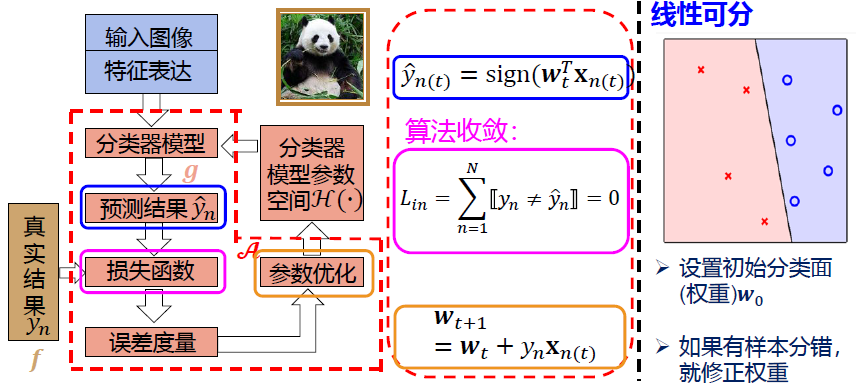

对于线性可分情况

模型的最终目的是实现收敛,即全部样本完全正确划分

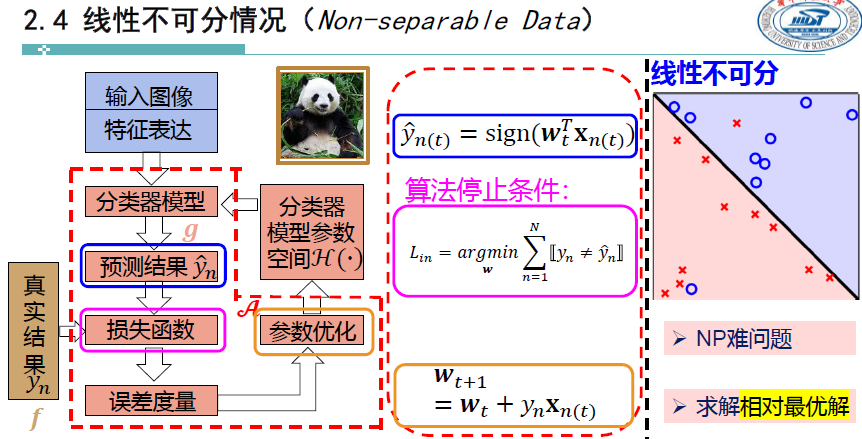

对于线性不可分情况

调整模型算法停止条件为:损失函数最小

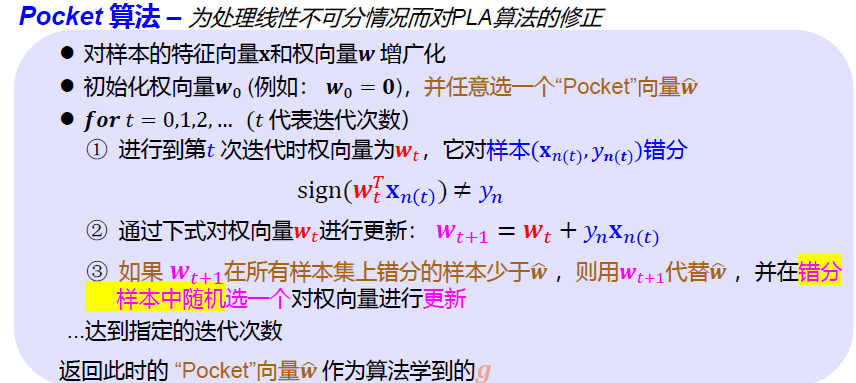

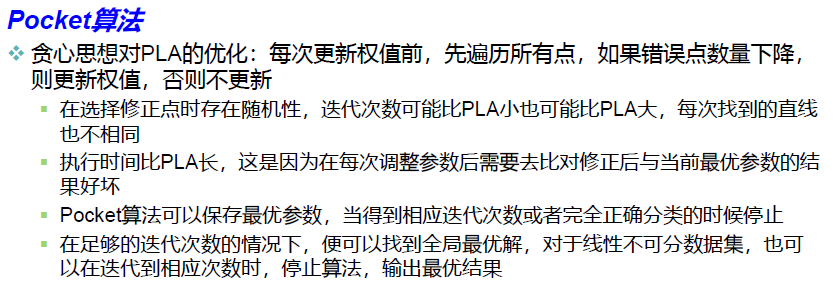

Pocket算法

为处理线性不可分情况而对PLA算法的修正

小结

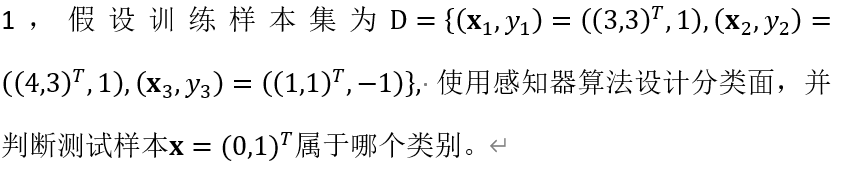

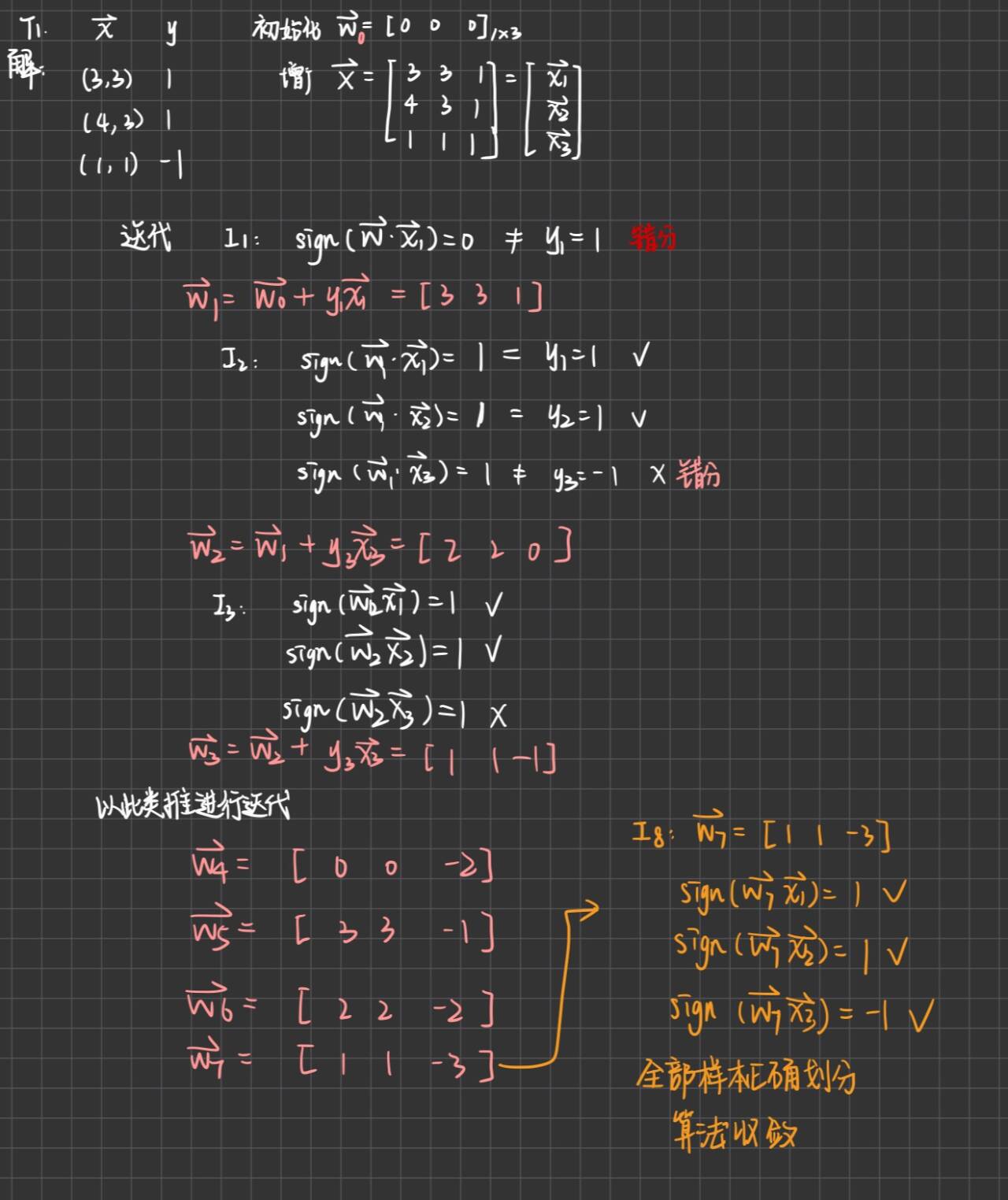

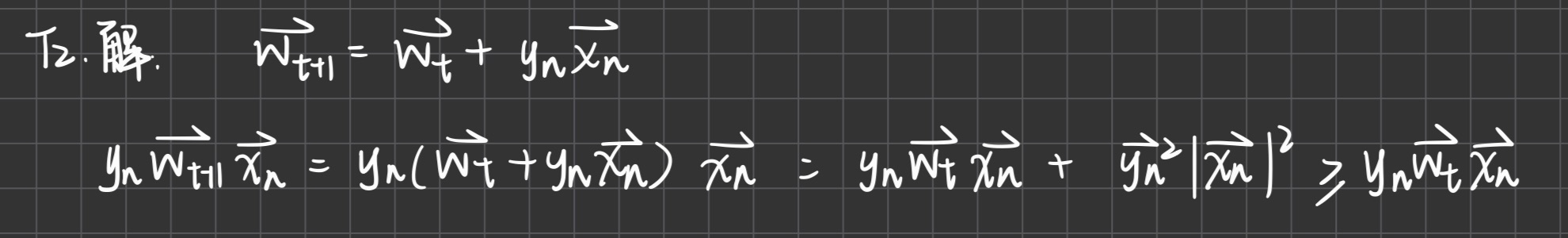

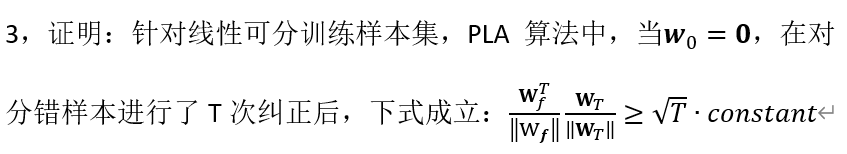

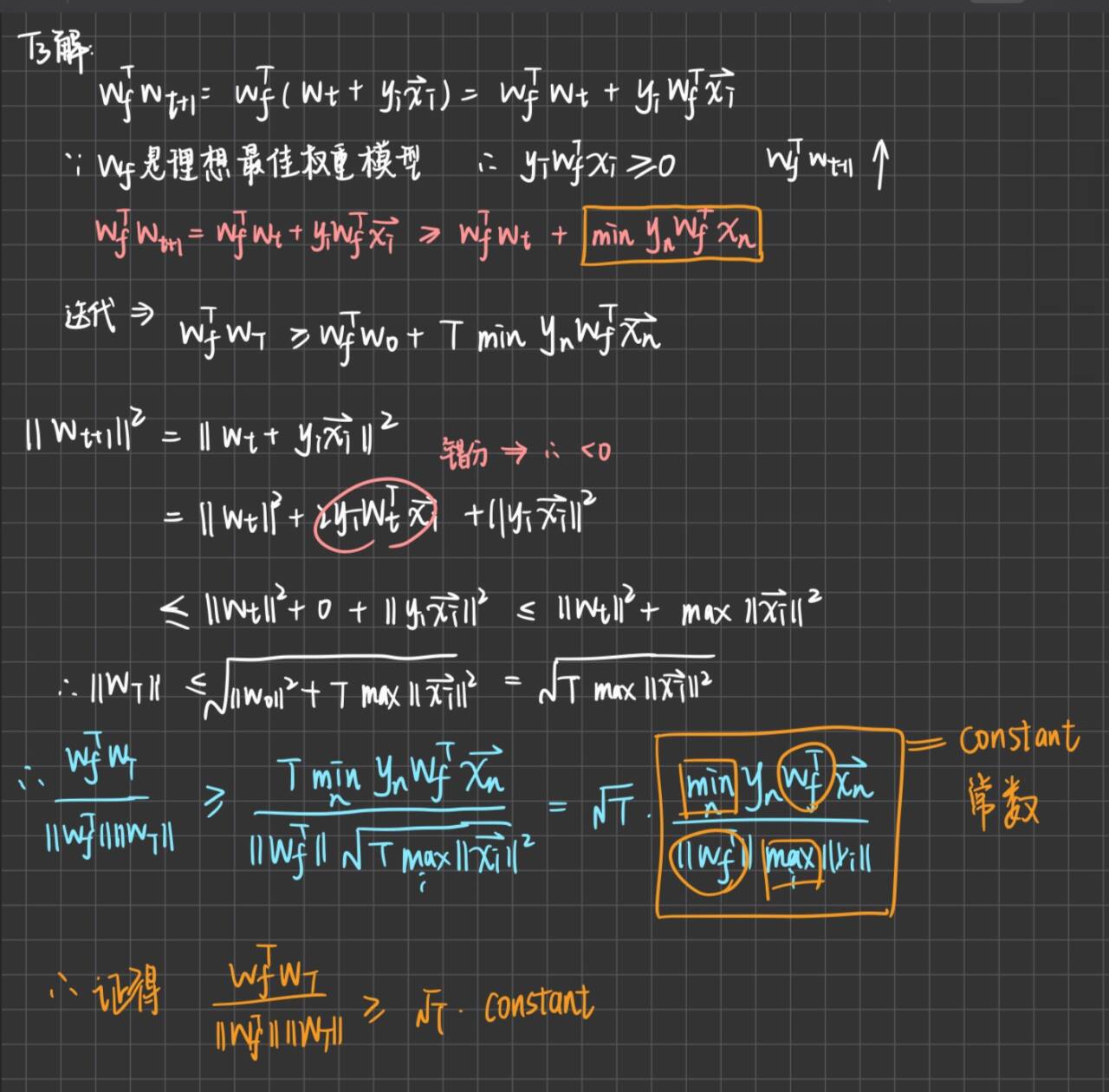

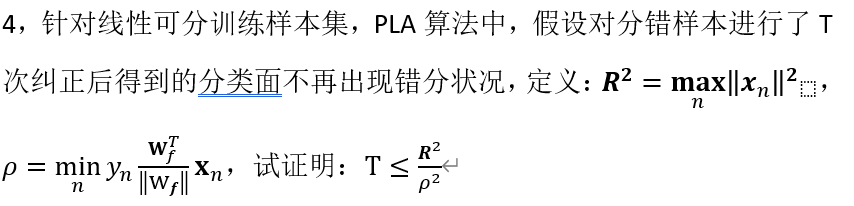

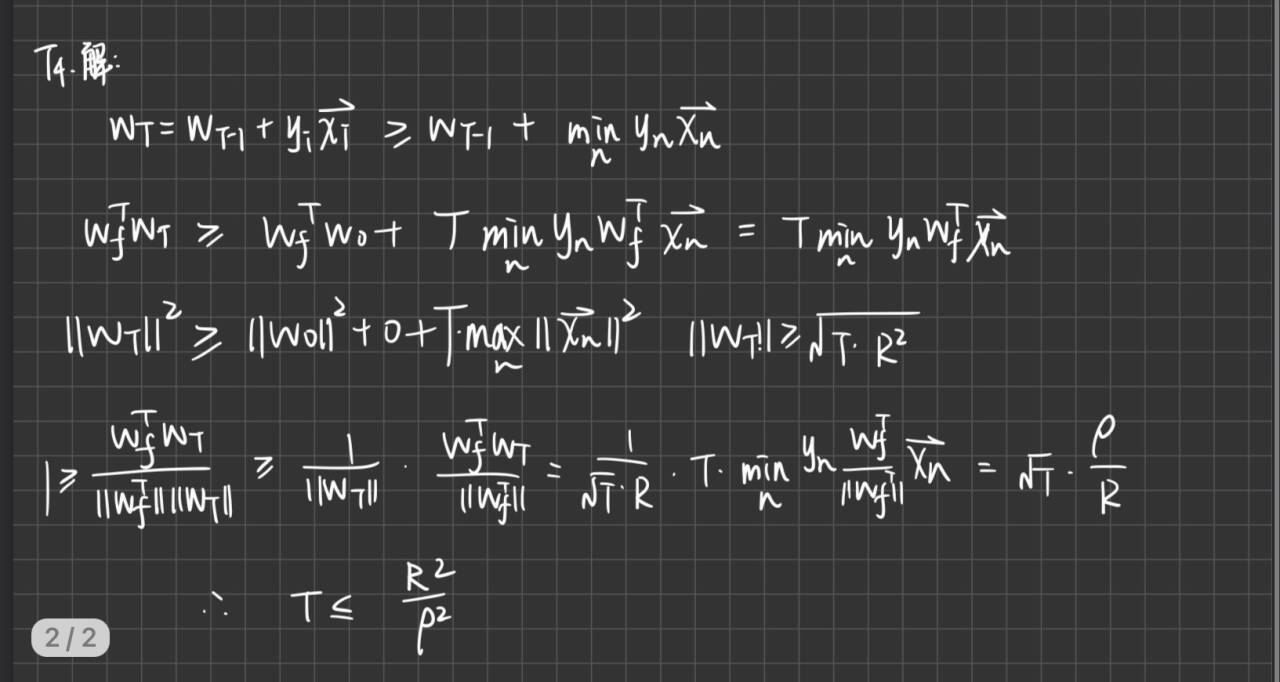

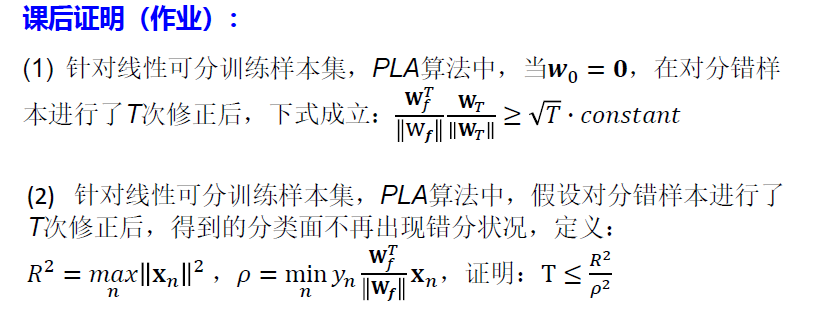

作业部分

手写作业